OPEN AI et sa communication autour de la controverse

L’INFORMATION ET

LA COMMUNICATION AUTOUR DE LA CONTROVERSE

Les logiciels issus de OpenAI ont beaucoup fait parlé d’eux. Notamment, ChatGPT et Dall-E. Pourtant, l’entreprise n’a pas forcément communiqué sur la controverse entourant leurs applications. Au – delà de quelques interventions, l’entreprise n’a pas réellement communiqué sur cette controverse.

Comment a-t-elle pris autant d’ampleur auprès des médias et comment l’entreprise a-t-elle géré la crise ?

La présence d’Open AI et ses applications sur les réseaux sociaux

En tant qu’entreprise, elle est présente sur des réseaux sociaux qui lui permettent de communiquer sur ses avancées et sur ses nouvelles créations. On peut la retrouver sur le réseau social professionnel par excellence, Linkedin ou encore X (Twitter). Ils y partagent les dernières nouvelles de l’entreprise, notamment les nouveaux membres de leur comité, ou le lancement de leur nouvelle IAG. YouTube est aussi utilisé comme un réseau professionnel, car les contenus sont ressemblants à ceux présents sur X (Twitter) et LinkedIn, la seule différence vient du format vidéo, utilisée pour présenter ces contenus.

Github pour le partage de documents aidant à l’utilisation de ses applications. On y retrouve des créations issues de ChatGPT qui peuvent être utilisées, comme des recettes par exemple. Ou encore des tutos pour bien réaliser ses requêtes sur leurs applications.

Enfin, OpenAI est présent sur SoundClound où ils partagent les créations issues de leur générateur de son, JukeBox.

chatgpt & jukebox

Ces deux logiciels sont mentionnés sur tous les réseaux sociaux de OpenAI, sans pour autant avoir leurs propres réseaux. Les productions issues de ChatGPT et de JukeBox sont souvent relayées sur les réseaux sociaux, sans que l’entreprise n’ait décidé de créer de vrais réseaux pour l’application.

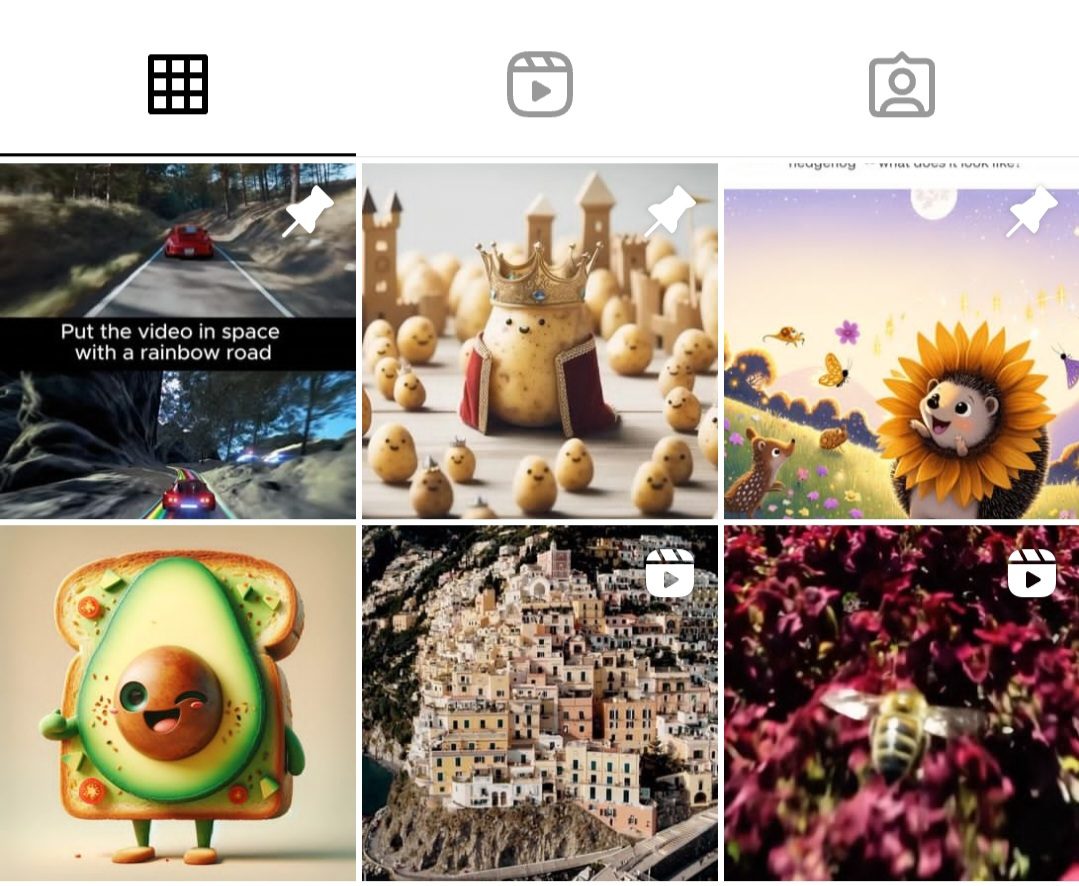

dall-e

Ce logiciel d’Open AI est le seul à posséder sa page Instagram. Et pour cause, c’est une application qui crée un contenu qui se prête aux codes de la plateforme sociale. Dall-E propose des concepts qui se prêtent aussi à la plateforme. Notamment, leur story à la une “DMs” qui consiste à créer des images issues des DMs envoyés par les followers. Les publications Instagram sont principalement des images issues de l’application. Des images générées grâce aux propositions des abonnés, des artistes et des personnes lambdas qui s’amusent à utiliser l’application.

Une controverse relayée par les médias et les réseaux sociaux

Les médias qui relayent des informations sur la controverse des Intelligences artificielles génératives, proposent une information qui répond à des questions que le grand public se pose. Les journaux utilisent des titres tels que “l’éducation doit-elle avoir peur des intelligences artificielles génératives” ou encore “les intelligences artificielles génératives vont-elles tuer Internet”. Des questions liées à la mauvaise utilisation de ChatGPT dans le cadre scolaire, les élèves utilisent de façon abusive l’application, pour lui faire faire leurs devoirs.

OpenAI communique dans le cadre des mises à jour de leur application. Sur leur site internet, un blog est présent. Blog sur lequel des centaines d’articles sont présents et parlent des mises à jour, des nouvelles fonctionnalités et d’autres éléments de leurs applications. Les informations sont donc à trouver sur les réseaux sociaux d’OpenAI, et elles sont relayées par la suite par des médias.

Lorsqu’il s’agit d’images, Dall-E est mentionné pour des dérives d’utilisation. La dérive principale observée, c’est la génération d’images à caractère pornographique, que ce soit de personnes lambdas, mineurs ou majeurs, et de personnalités publiques. De nombreux exemples peuvent être donnés. Notamment, avec la chanteuse Taylor Swift qui mène des actions en justice contre les personnes ayant généré ce type d’images.

Les médias considèrent l’entreprise comme trop secrète, ce qui s’avère être plutôt véridique. Il est rare de voir des articles ou encore des prises de paroles de la part des membres d’Open AI sur la controverse autour de leur générateur de contenus. Seul Elon Musk qui ne fait plus partie du conseil d’Open AI a pris la parole sur le “danger” potentiel des IAG de l’entreprise dans un tweet. Tweet dans lequel il dénonce ce qu’est devenue cette entreprise à but non-lucratif qui l’est finalement devenue et il précise que ce n’était pas ce qu’il voulait.

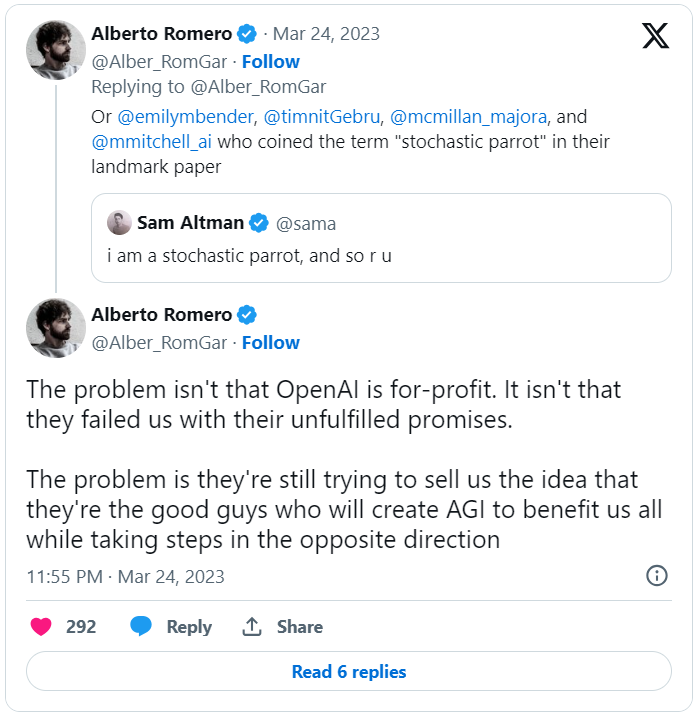

Alberto Romero, qui est l’auteur d’une newsletter reconnue sur l’intelligence artificielle, dénonce, dans un thread X (Twitter), la politique de plus en plus fermée d’Open AI. Le but de l’entreprise était de créer une base de données open source bénéfique pour l’ensemble de l’humanité, venant d’une entreprise à but non-lucratif. L’entreprise est devenue le total opposé de leur promesse ce qui entraîne un manque de confiance.

ILS EN ONT PARLE AUSSI

LEUR POSITION DANS LA régulation de l’ia

Les prises de parole

La seule prise de parole de l’entreprise vient du PDG, Sam Altan, et de son équipe qui, dans des interviews dans lesquelles ils adressent les inquiétudes du public face à leur modèle d’IAG. Ils assurent s’inquiéter des conséquences que peuvent engendrer leurs outils, et mettent en garde les autres entreprises sur la gérance de leurs applications. Mais, en même temps, nous ne savons pas comment, eux, gèrent leurs applications, ce qui laisse le doute et un manque de confiance envers l’entreprise.

LA TRANSPARENCE

Ce qui est reproché à l’entreprise, c’est leur manque de transparence, ils ne parlent pas de leur modèle. Il est impossible de faire confiance complètement confiance à ces modèles. La dernière version de leur générateur de texte, ChatGPT4, est encore plus opaque que ses prédécesseurs. Aucune information, sur le modèle, la façon dont il a été entraîné ou encore sur quelles bases de données il a été entraîné, n’ont été révélé au grand public. Et leurs raisons, pour ne pas partager sur ce sujet, viennent de la compétitivité du secteur et de la sécurité de leurs modèles. Sam Altan, le PDG d’Open AI, s’est exprimé sur le manque de transparence de l’entreprise. Il confie être lui-même effrayé par la création d’Open AI, tout en justifiant le manque de transparence est lié aux décisions de sécurité mises en place au tout début de ChatGPT et qui avait été ridiculisé. Il ne souhaite plus passer par cette phase, d’où le manque de transparence.

Conclusion

Ils ne prennent pas ouvertement position sur la régulation des intelligences artificielles générative, mis à part demander à leurs concurrents de gérer correctement leurs modèles. La seule action qui pourrait être prise pour une prise de parole sur la controverse, et leur engagement avec le gouvernement de Biden. Le décret signé à la Maison Blanche demande aux plus grandes entreprises d’IAG de s’engager volontairement pour des systèmes sûrs, sécurisés et confiants. Et Open Ai fait partie de ses entreprises qui se sont engagées volontairement, c’est les seules actions et communications que l’entreprise mènent sur la réglementation de ses IAG.

Les gouvernements se rendent compte de ce manque de transparence et créent des réglementations pour gérer l’éthique des systèmes d’IAG.